张文宏“被AI带货”,监管如何跟上技术发展?

“张文宏是不是带货了?”最近,有网友称在网络卖货视频中看到知名医生张文宏在售卖一种蛋白棒产品。不过,经常刷短视频的朋友很快就能分辨出这是AI合成的视频,并非本人。

随着人工智能技术的迅猛发展,AI换脸已经能够做到以假乱真。当AI技术被不当使用,用户该如何识破骗局?监管如何跟上技术发展?

张文宏回应“被AI带货”:已多次投诉但违规账号屡禁不止

在带货视频中,被合成的人像反复介绍一种产品,声音听起来很像张文宏本人。一些老人信以为真,不仅下了单,还呼朋引伴来购买。对此,张文宏回应称,这样的卖货账号不止一个,而且一直在变,他多次向平台投诉但屡禁不绝。

目前,用语音合成来模仿他人声音,生成视频的技术已经非常成熟,甚至仅用一张照片就能生成此类视频。

工信部信息通信经济专家委员会委员盘和林表示:“AI技术冒充名人带货、诈骗越来越多,这里的关键不在AI,而是要及时处理利用AI冒充他人的内容发布者。冒名顶替、虚假宣传、破坏名人肖像权、利用名人的公信力来牟利,这些行为会给名人带来风险,也会成为诈骗分子的温床。”

工信部反诈工作专班专家李坤介绍,在网上,耳听眼见不一定为实。“拟声”“换脸”等合成技术的一大特点是以假乱真,不法分子可以利用此类技术轻易伪装成他人,并通过快速筛选目标人群、精准制定诈骗脚本。

“不法分子通过各种公开渠道获取受害人的个人肖像或视频,然后利用AI技术对受害人面容特征进行学习,模仿眨眼、摇头等动作,实现以假乱真的效果。”李坤说。

推荐阅读

洗澡时浴霸突然冒烟起火 这两个功能切勿同时开启

央视新闻客户端2026-01-19 11:38:30

转发周知!春运火车票今起开售 购票有这些新变化

央视新闻客户端2026-01-19 08:30:35

跨境贸易便利化再升级!促进我国外贸稳量提质

新华社2026-01-18 09:04:31

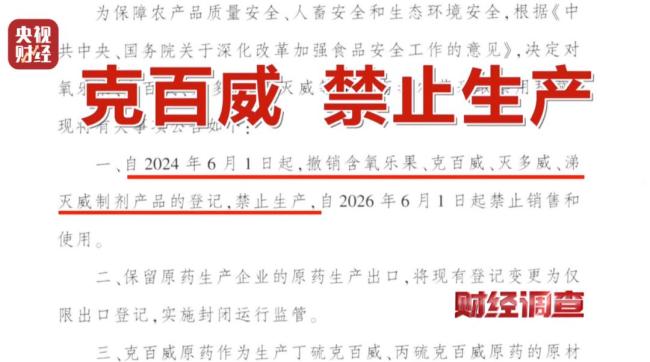

央视揭露菜商使用含毒农药 违规销售屡禁不止

封面新闻2026-01-19 14:04:46

日媒曝中国要求日企提交更详尽材料 稀土出口受限引发连锁反应

星夜不失眠人2026-01-19 10:56:18

内塔尼亚胡罕见公开“叫板”特朗普 以美分歧显现

文汇报2026-01-19 13:14:14

海南封关首月10个入境老外9个免签 首月免签入境外国旅客同比增长64%

微博2026-01-19 13:50:45

8岁哥哥带4个月大弟弟坐地铁 温情一幕获赞

大河网2026-01-19 13:55:07

交警零下40度救援遇险货车,交警及时出手!

澎湃2026-01-19 14:00:02

伊朗手机用户发送短信功能恢复 通信限制逐步解除

央广网·新闻2026-01-19 13:32:22

美国财长为特朗普撑腰 贝森特再度向美联储施压

新浪2026-01-19 13:55:31

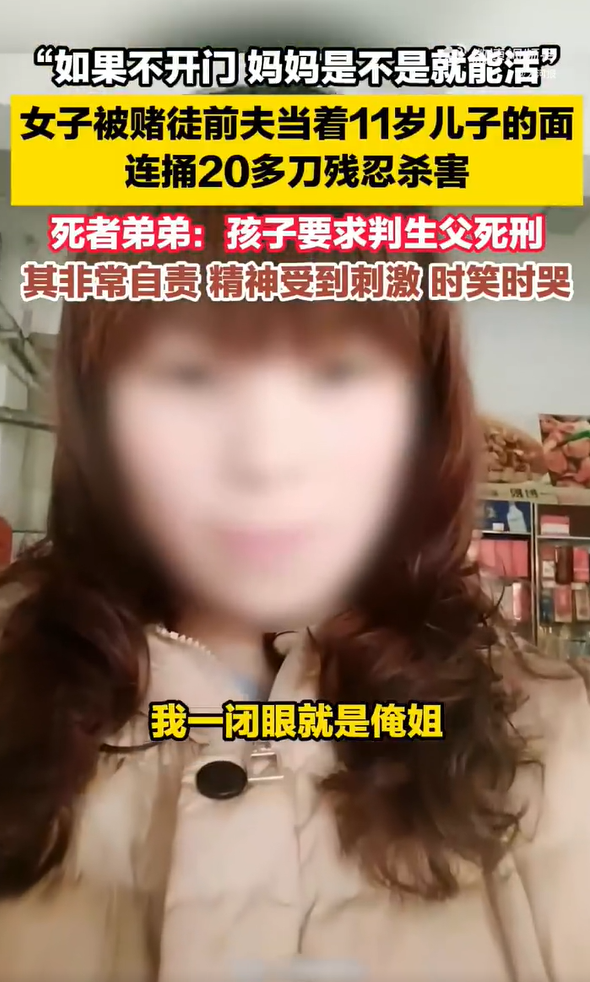

赌徒杀妻案将开庭

微博2026-01-19 13:54:47

美国邀约60国加入特朗普版联合国 引发多方谨慎回应

百家号2026-01-19 11:24:17

为啥每年过春节,解放军都要保持高度紧张的“战备状态”?

今日头条2026-01-19 13:20:41

张杰未live巡回演唱会 开往1982音乐之旅

网易2026-01-19 13:11:06

美国土安全部长为移民执法行动辩护 维护公众安全承诺

腾讯新闻2026-01-19 13:30:46

日本密集外交搞了哪些小动作 外交背后的扩军图谋

千龙网2026-01-19 13:27:37

俄称打击乌能源交通基础设施 瞄准战争命脉

妙语嘚吧嘚2026-01-19 11:23:54

日本仍未正视侵略罪行 右翼政府逆历史潮流

京报网2026-01-19 13:27:57

美国移民执法政治化的结构性裂变 街头冲突映射深层分裂

刘澜昌2026-01-19 11:02:48

母牛离世 刚出生牛犊站墙边流泪 深情一幕触动人心

网易2026-01-19 13:52:30

劣迹艺人打信息差到县域商演捞金 让违规复出的劣迹艺人没市场、无流量

新华社2026-01-19 13:57:14

高原雪韵盼春来 冬日美景迎新春

新华网2026-01-19 14:02:52

德:将同欧洲伙伴应对美加税 欧盟反制清单激活

微语海风2026-01-19 10:59:27

火箭119-110战胜鹈鹕 杜兰特18+6+8 小贾巴里爆发32分

懂球帝2026-01-19 13:59:39

饭店刚开业花篮凌晨遭恶意破坏

微博2026-01-19 13:56:54

樊振东逆风翻盘解说忍不住狂说漂亮 每个凌晨困了的人都被樊振东拿捏了!

微博2026-01-19 14:04:24

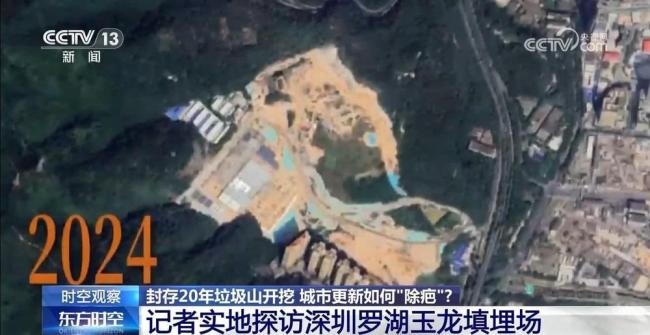

深圳沉睡二十多年的垃圾山正在消失 深圳为城市更新根治“顽疾”

央视网2026-01-19 14:04:04

伊朗紧急发出“全面战争”警告 局势紧张升级

搜狐网2026-01-19 11:11:19

博主称鄱阳湖疑发现20多处毒稻谷点 珍稀候鸟接连倒下

贝贝的守护星2026-01-19 14:00:45

专家:格陵兰岛难逃美国魔爪 欧洲象征性派兵难阻夺岛

网易新闻2026-01-19 11:50:24

宁乡流沙河刨猪宴开席 比过年还热闹些!

头条2026-01-19 13:59:22

高市欲提前选举 反高市联盟马上成立 在野党联合抗争

百家号2026-01-19 11:49:15

274元网购90白鹅绒羽绒服竟是飞丝 网购羽绒服拆开全是飞丝被商家拉黑

微博2026-01-19 14:02:26

神20返回任务圆满成功 舱内物品状态良好

一财网2026-01-19 10:55:16