AI仿冒名人带货属违法行为 深度伪造技术隐患显现

如今,从智能家居的语音助手到自动驾驶汽车,从高效能的数据分析到医疗领域的精准诊断,AI正以前所未有的方式改变着世界。然而,随着AI技术的不断发展和应用,其双刃剑的特性也逐渐显现。深度伪造技术就是其中之一,它利用人工智能算法生成高度逼真的虚假视频或图像,通过深度学习算法分析大量真实数据,学习特定人物或场景的特征,并生成与之极为相似的虚假内容。这种技术使得造假变得更加容易和难以辨别,给社会带来了诸多安全隐患。

今年以来,AI深度伪造假冒名人的事件时有发生。不久前,有人利用AI技术深度伪造了张文宏医生的脸部和声音进行直播带货。在这段视频中,被合成的人像反复介绍一种产品,声音也很像张文宏本人,商品中的蛋白棒产品已经售卖了1200多件。目前该账号已经搜索不到。张文宏医生对有人利用AI模仿自己带货的行为非常气愤,表示这种情况已经持续了几个星期,尤其是对于不熟悉AI技术的年长市民,他们很容易相信这些虚假信息。

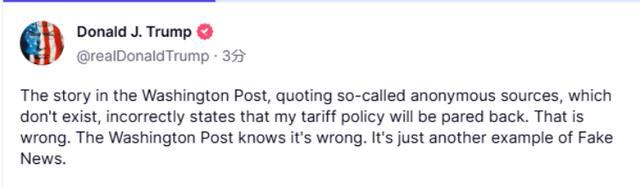

用AI制作假冒名人欺骗网民的现象并非个例。今年国庆期间,有人用企业家雷军的声音和头像制作了众多恶搞视频。还有人利用刘德华的声音为自己增加流量。该视频出现后,刘德华电影公司连续发布两则声明,提醒各方人士注意,避免落入伪造刘德华声音的AI语音合成技术骗局。上海市消保委也注意到最近日益增加的AI假冒名人的视频,认为这种行为是对消费者合法权益的侵害,是一种赤裸裸的欺诈行为。

现在的AI技术在克隆他人面部和声音上已经非常成熟,提供一张照片就能做出换脸的效果,他人的声音也能被轻易模仿。专家介绍,通过人工智能技术可以将脸进行替换,声音需要有一个语言模型,将被模仿者的声音进行合成,实现音色的克隆。技术人员现场做了一个测试,将事先录制好的视频换成记者的脸和声音。记者提供了一张证件照片,不到两分钟,通过软件的渲染,视频的人脸就换成了记者的脸。随后是声音的AI制作,记者现场录制了一段声音输入到AI资料库中,很快AI就能用记者的声音播报任何文本内容。最终合成的视频效果非常逼真。

尽管AI模仿度高,但并非毫无破绽。专家表示,这种既要换脸又要换声的操作只能制作视频,无法做到实时直播。观众通过仔细辨认视频,也能看出AI的痕迹。辨别时可以重点关注视频中人脸的变换,包括人脸轮廓和背景环境融合度、协调度等。另外,在语音、语速和口型的匹配度上也可以去重点关注。

未经授权利用AI假冒他人属违法行为。专家表示,那些未经允许使用他人形象的行为均属于违法行为。按照民法典的规定,未经权利人同意,任何人不得侵害他人的人格权利。不仅不能直接使用,也不能使用当事人的人脸信息、声音信息进行深度合成。如果把相关视频,包括声音编辑之后形成了相关内容,这属于伪造的信息,按照网络安全法的规定,这属于违法信息。此外,AI假冒名人发表自己的作品,有可能会追究发布者的刑事责任。

专家表示,AI假冒名人进行带货这样的行为已经涉嫌违法,一旦消费者信以为真购买了产品,可以要求商家退一赔三。消费者权益保护法明确规定,如果消费者遭到了欺诈,可以要求不法商家进行赔偿。具体的赔偿标准是退一赔三,如果不足500元,消费者完全可以要求商家按照500元进行赔偿。短视频平台也应该担负主体责任,有义务防范AI假冒名人视频在自己的平台大量传播。如果发现利用AI合成的声频和视频传播虚假消息,应当对发布者采取包括信用管理在内的强制措施,根据信用的降低,要随之产生必要的处罚措施。

相关新闻

AI仿冒名人带货属违法行为 消费者可要求退一赔三

如今,从智能家居的语音助手到自动驾驶汽车,从高效能的数据分析到医疗领域的精准诊断,AI正以前所未有的方式改变着世界。然而,随着AI技术的不断发展和应用,其双刃剑的特性也逐渐显现。

2024-12-23 07:43:53退一赔三央视揭AI假冒名人带货乱象 深度伪造频发

2024-12-23 15:10:02央视揭AI假冒名人带货乱象记者实测AI换脸搭配声音合成 揭秘假冒名人带货乱象

近年来,AI深度伪造技术被频繁用于假冒名人进行直播带货和其他活动。例如,有人利用这项技术伪造了张文宏医生的脸部和声音进行直播带货,售卖的蛋白棒产品已经售出1200多件

2024-12-23 13:42:45记者实测AI换脸搭配声音合成堵车时闯绿灯属违法行为

2024-12-02 10:38:26堵车时闯绿灯属违法行为张文宏“被AI带货”,监管如何跟上技术发展?

“张文宏是不是带货了?”最近,有网友称在网络卖货视频中看到知名医生张文宏在售卖一种蛋白棒产品。不过,经常刷短视频的朋友很快就能分辨出这是AI合成的视频,并非本人。

2024-12-14 15:08:21张文宏“被AI带货”堵车时闯绿灯属违法行为 影响通行效率

12月2日是我国第13个全国交通安全日,今年的主题是“文明交通,携手共创”。我们都知道“红灯停、绿灯行”,但有时候,即使绿灯亮起也不能通过。例如,在交叉口遇到拥堵时,机动车“闯绿灯”就属于违法行为

2024-12-02 10:13:03堵车时闯绿灯属违法行为