AI换脸软件包月30元可无限次使用 滥用风险引热议

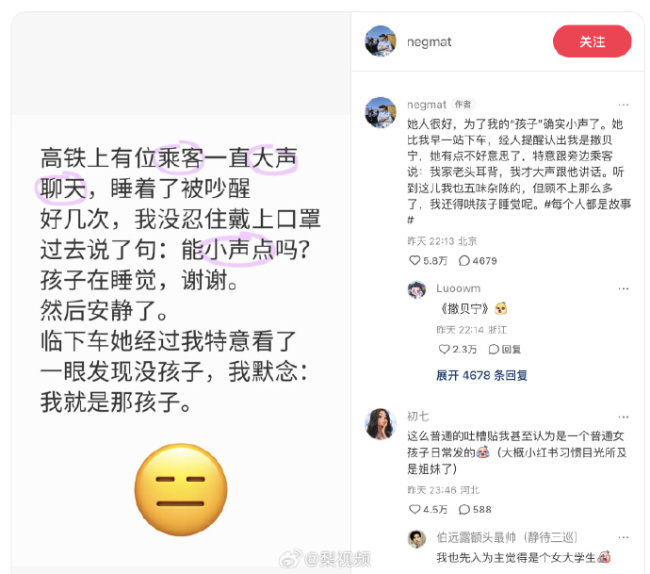

近日,知名模特叶凯薇因被利用AI换脸技术制作淫秽视频而引发广泛关注,这一事件再次将AI换脸滥用导致的违法侵权问题推向风口浪尖。记者通过体验发现,网络上可以轻松找到相关应用软件和教程,电商平台也有商家售卖此类软件,甚至声称能达到“100%逼真”。

在多个社交平台搜索关键词“AI换脸”,会出现各种提示信息,提醒用户注意风险。提示下方则是推荐AI换脸软件、网站的帖子,封面图多为女明星照片,并附有吸引人的标语,如“一键换脸,秒变明星脸”等。评论区中,不少网民询问如何获取和使用这些工具。

在某短视频平台,搜索“AI换脸”的内容更加丰富,包括自带链接的教程、小程序、特效和免费软件。一些教程视频展示了如何将影视片段中的明星脸部替换,效果从粗糙到自然不一。记者尝试了一款工具,上传人脸照片后需付费2.88元,生成的视频虽然表情略显生硬,但整体契合度较高。

电商平台上,搜索“AI视频换脸”会显示法律提醒或无相关商品。改为搜索“AI换”,则能找到提供AI技术转换服务的商家。收费标准从10元到50元不等。客服表示,付费后会提供软件用于视频换脸,操作简单且可实现高清导出。部分客服声称能做到100%逼真,还提供一对一指导。对于是否可以用明星照片换脸的问题,多数客服表示可以娱乐使用,但也有客服明确拒绝。

在另一家电商平台,搜索“AI视频换脸”同样无结果,搜索“AI换”则出现提供换脸、换装服务的商家。联系后,部分商家表示无法进行明星视频换脸,原因涉及肖像权问题。

此外,一些应用程序在操作过程中会弹出提示,禁止上传涉黄违规内容,一旦发现将永久封禁。

专家刘志远表示,随着AI技术的发展,声音克隆和换脸技术越来越普及,门槛降低使得普通用户也能方便使用。防范风险需要多方共同努力。一方面,在工具源头加入水印功能,明确表示这是AI生成的内容,并提供警示信息。另一方面,各大视频平台应加强检测力度,对可能是AI生成的内容予以醒目提示。最重要的是,法律法规层面应加强管理,制定相关规定,明确AI使用的场景和可能带来的法律后果。

相关新闻

AI换脸,积压剧回春?

2025-03-07 11:16:21AI换脸积压剧回春新华网评AI换脸诈骗 换脸骗术升级,警惕亲人被骗

2024-09-15 11:03:24新华网评AI换脸诈骗男子接AI换脸电话7秒被骗30万 AI诈骗频发

近日,一段知名传染病学专家张文宏直播卖蛋白棒的视频在网上流传,许多老人信以为真并纷纷购买,橱窗商品已售出上千件。然而,这实际上是一起利用AI换脸技术合成的侵权视频

2024-12-21 00:55:48男子接AI换脸电话7秒被骗30万AI换脸拟声风险怎么应对 治理挑战与对策

“AI换脸拟声”乱象频现,引发社会广泛关注。一些不法分子利用这一技术实施诈骗,让演艺界人士、专家学者、知名企业家等公众人物深受其扰

2025-03-12 10:41:12AI换脸拟声风险怎么应对知名模特被AI换脸制作淫秽视频:完善AI立法不能再等了

近日,知名模特叶凯薇发布视频表示,有人利用AI换脸技术制作淫秽视频,并广泛传播,给她带来了严重困扰。她已经收集证据并向警方报案。经鉴定,该视频确系伪造,警方正在进一步调查

2025-03-14 06:54:31知名模特被AI换脸制作淫秽靳东两会建议AI换脸立法 呼吁建立更好规则

3月5日,在政协小组讨论上,全国政协委员靳东谈及AI换脸导致的诈骗问题。他表示,一些喜欢他影视剧的观众因AI换脸视频被骗得很惨,这种行为性质非常恶劣,并希望相关部门能建立更好的规则来应对这一问题

2025-03-06 08:28:23靳东两会建议AI换脸立法