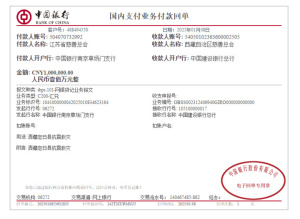

AI换脸诈骗,财务被骗转账186万元!怎么防范?专家教你这三招!(5)

不过,AI技术也是把“双刃剑”,即使是出于娱乐使用AI换脸、AI换声,也是存在法律风险的。法律专家表示,用AI技术为他人换脸换声甚至翻译成其他语言并发布视频,可能涉嫌侵权,主要有三个方面:

一是涉嫌侵犯著作权,

例如相声、小品等都属于《中华人民共和国著作权法》保护的“作品”。例如网友用AI软件将相声、小品等“翻译”成其他语言,需经过著作权人授权,否则就存在侵权问题。

二是涉嫌侵犯肖像权,

根据《中华人民共和国民法典》,任何组织或者个人不得以丑化、污损,或者利用信息技术手段伪造等方式侵害他人的肖像权。未经肖像权人同意,不得制作、使用、公开肖像权人的肖像,但是法律另有规定的除外。

三是涉嫌侵犯声音权,

根据《中华人民共和国民法典》规定,对自然人声音的保护,参照适用肖像权保护的有关规定。也就是说,需要取得声音权人的同意,才能够使用他人的声音。

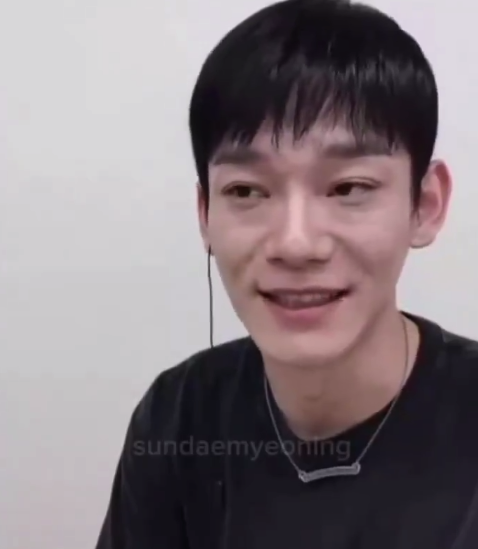

学会几招轻易识别AI“换脸换声”

AI换脸这一技术的出现,导致耳听为虚、眼见也不一定为实了。那我们该如何防范呢?专家表示,其实AI人工换脸无论做得多么逼真,想要识别视频真假还是有一些方法的。

中国计算机学会安全专业委员会数字经济与安全工作组成员方宇:实际上从我目前看到的深度伪造的实时视频上来看,其实还是可以通过一些方式,去进行一些验证。

那比如说我们可以要求对方在视频对话的时候呢,在脸部的面前通过挥手的方式,去进行一个识别,实时伪造的视频,因为它要对这个视频进行实时的生成和处理和AI的换脸。

相关新闻

防范“AI换脸”诈骗 你需要的知识都在这儿了→

近年来,随着人工智能技术的进步,一些不法分子开始利用AI技术融合他人面孔和声音,制造非常逼真的合成图像来实施新型网络诈骗,这类骗局常常会在短时间内给被害人造成较大损失。

2024-02-26 03:29:42AI换脸“AI换脸”骗走2亿港元 专家支招如何防范

AI已成为过去一年的网络热点,伴随其广泛应用,AI诈骗现象日益引起关注,尤其是运用AI换脸技术实施的诈骗案件屡见报端。

2024-04-22 15:11:05“AI换脸”骗走2亿港元男子改名收费19800元涉嫌诈骗罪 AI换脸诈骗新手段曝光

2024-06-21 08:23:04男子改名收费19800元涉嫌诈骗罪向太称遇AI换脸向佐诈骗 自己居然没认出来向佐

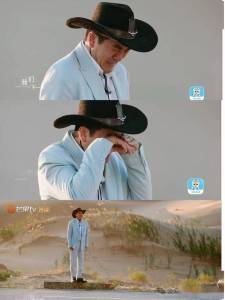

4月26日,向太发文称:我好像被向佐“电信诈骗”了!而我居然没认出来,还跟他视频聊天了,大家一定要小心现在AI换脸的科技,谨防被换脸亲友诈骗!

2024-04-26 10:57:29向太没认出来向佐轻信内部操作办理京牌被骗10万元 警方通报诈骗案情

近期,一起涉及伪造“法拍”京牌小客车指标的诈骗案件被北京通州公安分局揭露。5月24日的通报显示,该局在“春夏平安行动”中成功逮捕了一名诈骗嫌疑人

2024-05-27 13:14:43轻信内部操作办理京牌被骗10万元宁波:一个陌生电话,69万元被骗子当面取走!警惕新型诈骗手段

2024-06-05 07:10:46宁波:一个陌生电话