“Deepseek乱编”坑惨大学生?这个话题上热搜

在人工智能飞速发展的当下,对于广大学生和科研工作者而言,一个关键问题随之而来:

借助这样的前沿大模型写论文,真的靠谱吗?

3月28日,话题#防止DeepSeek乱编文献的方法#冲上热搜。记者注意到,用AI工具写论文“被坑”的经历,并非鲜见。

问AI一个问题,它给了你一个特别详细、丰富,看上去好有逻辑的答案。

但当我们去核实时,却发现这些信息完全是虚构的?

这就是著名的“AI幻觉”现象。

AI幻觉指的是AI会生成看似合理但实际确实错误的信息,最常见的表现就是会编造一些不存在的事实或者细节。

据“科普中国”,造成AI幻觉问题的成因很多,例如:基于统计关系的预测;训练数据的局限性;过拟合问题,即因为记住了太多错误或者无关紧要的东西,从而让AI对训练数据中的噪声过于敏感;有限的上下文窗口;生成流畅回答的设计等等。

近日,中国青年报邀请了3位专家学者,一起聊聊技术浪潮中如何守护年轻人的思辨能力。

中国人民大学新闻学院教授卢家银就指出,在知识建构上,AI生成的虚假学术成果,可能扭曲青年对科学方法论的理解,削弱其“假设-验证”的科研逻辑训练。

在思维发展上,AI谣言通过算法推荐的“信息茧房”形成逻辑闭环,不利于批判性思维的培养。

北京师范大学教育学部教授、教育技术学北京市重点实验室副主任李艳燕建议,年轻人可以把AI看作一位平等对话的智者,通过引导与AI的对话互动,促进个体思维链的形成,并校准认知偏差。这种去权威化的思辨训练,可以帮助年轻人在与AI的对话中保持独立判断,实现认知跃迁。

推荐阅读

身体出现这5个变化要重视 科学控糖指南请查收

央视新闻客户端2026-03-02 13:07:21

全球好物+科技感+春晚 “世界义乌”开市了

央视新闻客户端2026-03-01 08:26:26

国家电网将投产15项特高压直流工程

央视新闻客户端2026-03-01 08:25:57

3D还原以色列铁穹如何拦截导弹 特拉维夫夜空的震撼一幕

清静爱摄影2026-03-02 15:55:17

警察抓小偷女子挺身拦截被撞倒 勇敢市民助警方抓捕

新浪看点2026-03-02 15:51:07

家长投诉开学前被要求到校大扫除 呼吁学生自立

观威海2026-03-02 15:52:28

伊朗的致命隐患是内奸 核心机密被泄露

枫说2026-03-02 15:46:21

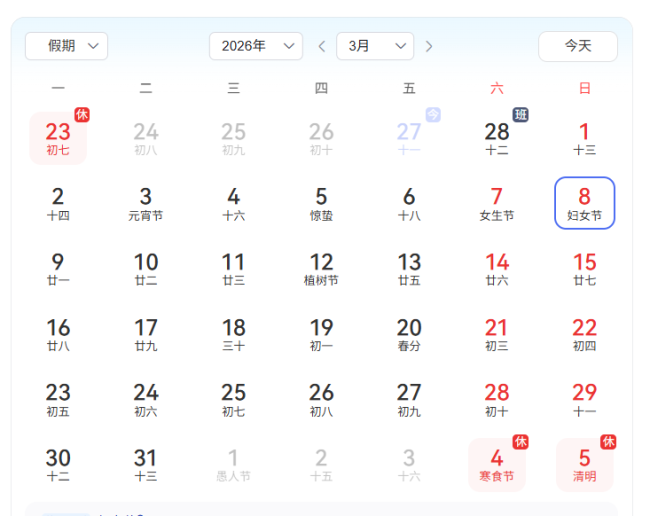

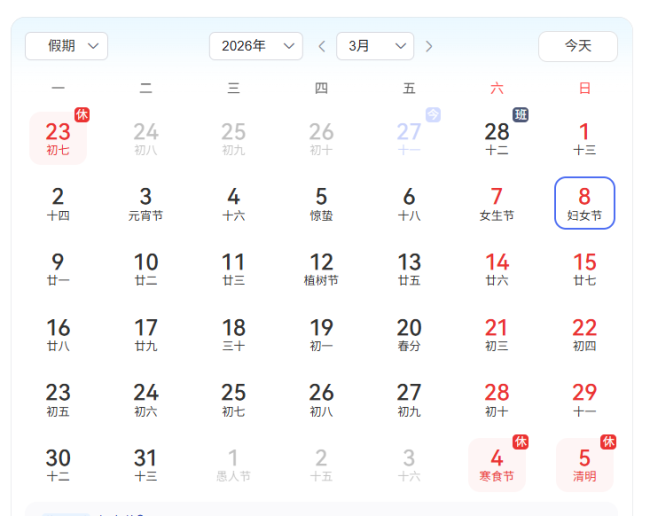

妇女节半天假撞上周日不补休 无补假但有加班费

百家号2026-03-02 15:50:35

中国给美以的侵略行径定了性!

今日头条2026-03-02 15:49:41

广西人年后的统一操作:不想吃年菜了,想出去吃粉!

微博2026-03-02 15:52:54

记者求证“男子杀鸭发现黄金” 真相待解

百家号2026-03-02 16:04:34

27座基地被炸,民众要求特朗普下台 中东局势失控

搜狐军事2026-03-02 15:43:50

伊朗强硬派被赶尽杀绝,亲美派安然无恙 内贾德生死成谜引发关注

石江月2026-03-02 15:54:50

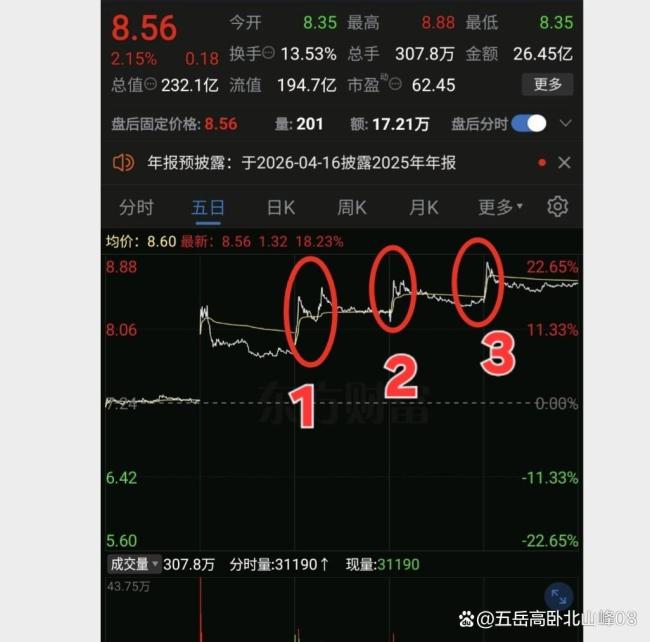

美伊冲突持续,A股集体低开 市场情绪波动显著

五岳高卧北山峰082026-03-02 16:13:30

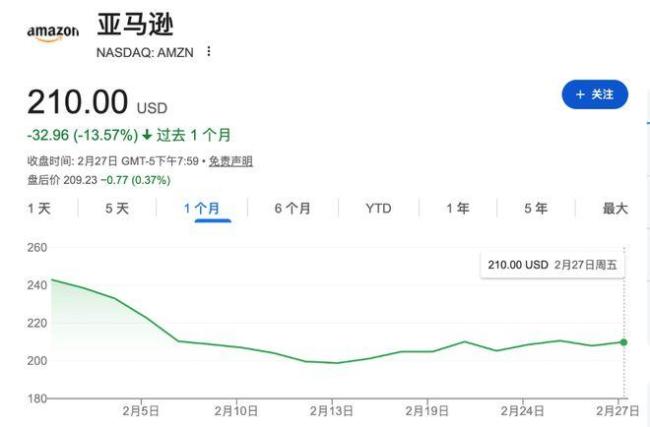

亚马逊的“AI战略” 低成本路线重塑竞争格局

新浪财经2026-03-02 15:50:08

吴谦的这段发言含金量还在上升 F-16危机暴露深层问题

是阿鹿鹿呢2026-03-02 15:58:53

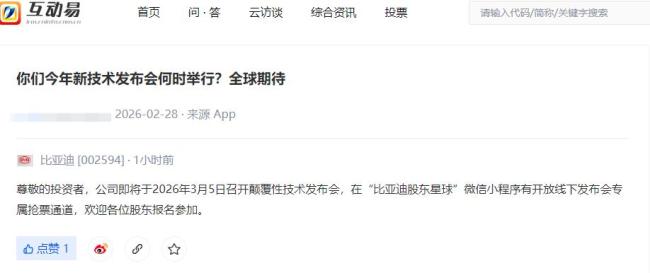

比亚迪股价上涨近8% 颠覆性技术发布会预告刺激市场

红星资本局2026-03-02 16:21:44

为什么狗对着空气汪汪叫?

头条2026-03-02 15:54:16

伊朗的导弹还有4000枚?中东局势紧张升级

历史滴温度2026-03-02 16:11:07

三七互娱被处罚后高管调整 涉事人员离职

南方都市报2026-03-02 16:23:35

伊朗一名中国公民遇难 外交部指导撤离与协助

每日经济新闻2026-03-02 15:58:09

伊朗决定“擒贼先擒王”?以色列空袭德黑兰核心目标

风烛悴月2026-03-02 15:58:27

下周这个法定假期不补休 妇女节撞周末无补假

澎湃新闻2026-03-02 15:49:00

比亚迪月销首次跌破20万辆 销量遇冷引发关注

中国基金报2026-03-02 16:09:27

石油价格大涨,要卡住中国脖子?霍尔木兹海峡成焦点

网易2026-03-02 16:15:48

伊朗爆炸声彻夜不停 民众恐慌加剧 局势升级引全球关注

旅行者观察世界2026-03-02 15:50:41

日本足协征集官方观赛团赴温布利看球,有“中间商”赚差价?

TSUBASA10 2026-03-02 15:54:43

特拉维夫40栋建筑遭伊袭击受损 中东火药桶引爆

琪琪聊国际2026-03-02 15:49:15

国投白银LOF涨近8% 贵金属板块集体拉升

同花顺财经2026-03-02 16:07:06

关注中东局势最新进展 紧张升级多国卷入冲突

烽火哨兵2026-03-02 15:59:59

伊朗正在押一场豪赌 地缘政治驱动油价

新浪2026-03-02 15:56:46

大学生用AI做了部《封神》 重塑妲己的女性主义觉醒

九年砍柴2026-03-02 16:11:42

一架美军战机在科威特被击落 疑遭友军误击

红网2026-03-02 15:55:57

伊朗的反击没有过夜,还有三大手段? 导弹+无人机齐上阵

搜狐网2026-03-02 15:44:22

为什么喜欢配角的观众越来越多?

微博2026-03-02 15:56:25