AI仿冒名人带货属违法行为 消费者可要求退一赔三(2)

用AI制作,假冒名人欺骗网民的现象,张文宏事件并非个例。今年国庆期间就有人用企业家雷军的声音和头像制作了众多恶搞视频。

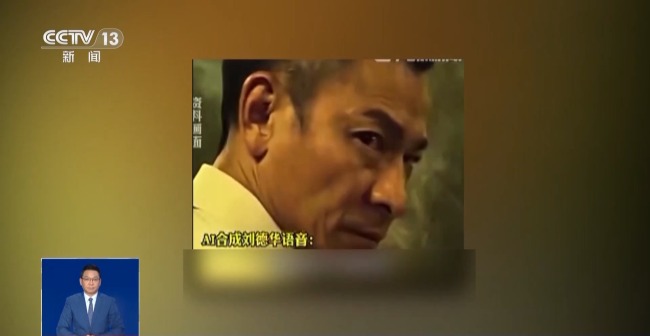

也有人AI制作了刘德华的声音为自己增加流量。该视频出现后,刘德华电影公司连续发布两则声明,提醒各方人士注意,避免落入伪造刘德华声音的AI语音合成技术骗局。

上海市消保委也注意到了最近日益增加的AI假冒名人的视频。

上海市消费者权益保护委员会副秘书长唐健盛:我们关注到现在这种虚拟人直播带货的情况,也是越来越多了。有不法商家通过AI手段去冒用张文宏老师的形象和声音,做的假的直播带货,这种行为我们觉得是对消费者合法权的侵害,因为它就是一个赤裸裸的欺诈消费者行为。

AI模仿他人技术成熟可轻松克隆脸和声音

现在的AI技术在克隆他人面部和声音上,到底发展到了什么程度?专家介绍,目前模仿他人的声音和脸的技术已经非常成熟,提供一张照片就能做出换脸的效果,他人的声音也能被轻易模仿。

中国网络空间安全协会人工智能安全治理专业委员会专家薛智慧:通过人工智能技术,将脸进行替换。声音需要有一个语言的模型,语言模型里边被模仿者的声音进行合成,实现音色的克隆。

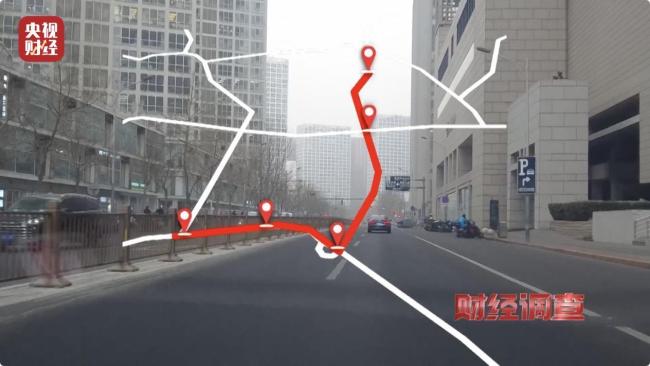

技术人员现场做了一个测试,将事先录制好的视频换成记者的脸和声音。首先记者给技术人员提供了一张证件照片,不到两分钟,通过软件的渲染,视频的人脸就换成了记者的脸。

推荐阅读

未成年人轻松绕开“防沉迷”系统 背后有哪些猫腻

央视新闻2024-12-23 01:11:17

“泼水成冰”易翻车 安全操作要点多

央视新闻2024-12-23 01:05:39

点餐、办卡、订酒店…我的个人信息怎么就被泄露了

央视新闻2024-12-23 01:00:17

特朗普喊话北约成员 军费加到GDP5% 提高军费要求引发关注

央视新闻2024-12-23 03:53:06

解放军驻澳门部队为何被称为“静音”部队?不扰民的贴心举措

新浪2024-12-20 15:28:00

普京谈叙利亚政权更迭 快速反应背后的考量

搜狐军事2024-12-20 15:44:26

本轮巴以冲突已致加沙地带45129人死亡 伤亡人数持续攀升

百家号2024-12-20 15:43:53

日方进入驻日美军基地调查污染物泄漏事件 多部门联合行动

环球时报2024-12-20 15:23:31

美国医疗制度是如何敲诈勒索美国人的 民众愤怒背后的深层原因

观察者网2024-12-20 13:17:08

云南一氧化碳中毒事件1死3伤 4名缅甸籍工人受害

百家号2024-12-23 07:38:29

李盈莹朱婷隔网对轰 科内利亚诺夺冠

澎湃新闻2024-12-23 06:25:27

首批海外网红博主来到长沙 体验文化与科技魅力

红网2024-12-23 07:36:17

俄苏34战斗机轰炸俄境内乌军

网易2024-12-20 13:34:27

武汉将开行到香港的始发高铁 班次翻倍便捷出行

极目新闻2024-12-23 04:15:52

盲人带导盲犬医院看病被拦 偏见与权利的碰撞

搜狐网2024-12-23 07:38:09

菲律宾在南海升级挑衅 中国反制加强奉陪到底

新浪财经2024-12-20 16:38:27

特朗普托安倍妻子转交石破茂书籍

今日头条2024-12-20 15:41:58

从业者称马斯克具有超强的解构能力

今日头条2024-12-20 15:04:42

特朗普2.0恐令全球央行政策重陷分化 美联储降息更颠簸

第一财经2024-12-23 03:45:20

剪刀脚锁喉!台立法机构又爆冲突

今日头条2024-12-20 15:03:36

普京称主权至关重要应该深植于心

今日头条2024-12-20 15:06:36

云南五旬教师捐献造血干细胞 传递生命希望

新浪·财经头条2024-12-23 07:34:10

波尔斯特:姆巴佩会在皇马取得成功 情绪问题解决后将完全适应

直播吧2024-12-23 01:45:44

上海地铁11号线乘客发声 强烈撞击感如脱轨

极目新闻2024-12-23 07:21:56

韩国激光武器赶鸭子上架,连烧10-20秒才干掉1个目标

腾讯2024-12-20 16:40:01

法国最高法院就萨科齐贪腐案最终裁决:萨科齐获刑3年 无需入狱佩戴电子手环

北京商报2024-12-20 15:25:58

布林肯称援乌是给特朗普谈判留好牌 拜登移交北约架空特朗普权力

看看头条·中华网2024-12-20 14:44:58

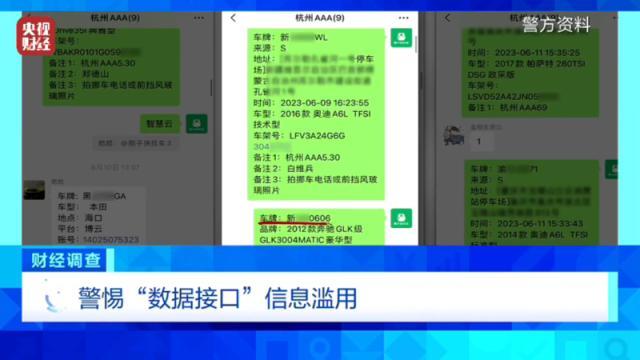

停车就泄露数据竟成黑产业链 斩断盗卖个人信息黑手

中国青年网2024-12-23 07:38:48

直播间榜一大哥1周骗走女主播7.4万 甜蜜陷阱背后的真相

极目新闻2024-12-23 03:30:57

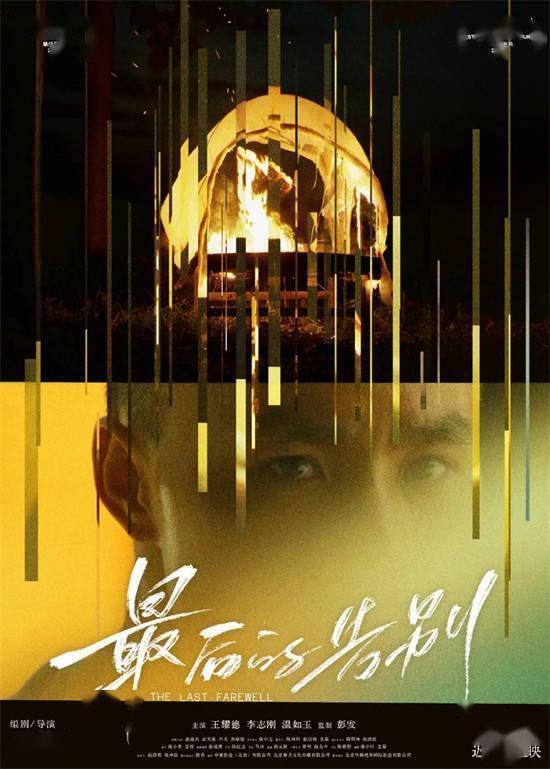

北电保安拍电影获大奖 草根逆袭梦想成真

搜狐娱乐2024-12-23 07:42:51

以军被爆在加沙进行杀人比赛 任意射杀平民引发争议

百家号2024-12-20 13:16:44

美称仍援乌是为给特朗普谈判留好牌

今日头条2024-12-20 15:05:09

北京PM2.5和碳排放双降 生态环境持续改善

网易2024-12-23 07:40:26

男子暴瘦110斤后被质疑戴人皮面具

搜狐网2024-12-23 07:31:45

青岛海关查获含肉毒杆菌毒素制剂 未获审批禁止入境

环球网2024-12-23 02:58:41