什么是deepfake视频?

近期,韩国发生多起利用深度伪造技术(deepfake)制作并传播淫秽影像的案件,去年的时候俄罗斯进攻乌克兰后的第三周,乌克兰官网发布了一段乌克兰总统泽连斯基的视频。在视频中,泽连斯基穿着他标志性的绿色T恤,神情略显僵硬地呼吁乌克兰军队放下武器,向俄罗斯投降。这一视频迅速引发了公众的强烈反应,但很快人们发现,这其实是一个经过篡改的假视频。

事实上,这段视频是黑客利用深度伪造技术制造的虚假内容。深度伪造技术,也称为Deepfake,最早出现在一个名为“Reddit”的社交平台上。在这个平台的一个社区中,用户分享和传播了大量女明星的虚假色情视频。这个社区不仅仅是分享这些虚假视频,还提供了AI换脸软件,能够自动将视频中的人脸替换成另一个人。尽管Reddit后来关闭了这个社区,但这项技术已经广为人知,并逐渐被应用于政治人物和演员的视频中。

那么,什么是深度伪造技术呢?

Deepfake一词由“深度机器学习”(Deep Machine Learning)和“假照片”(Fake Photo)两个词组合而成。它通过人工智能技术中的深度学习模型,将图片或视频叠加到原始内容上。借助神经网络技术,经过对大量数据的学习,将人的声音、面部表情及身体动作合成为非常逼真的虚假内容。深度伪造技术最常见的应用是AI换脸,此外还包括语音模拟、人脸合成和视频生成等技术。

2018年,美国导演兼演员乔丹·皮尔(Jordan Peele)发布了一段视频,在这段视频中,奥巴马的形象和口吻被用来发表一句“特朗普是一个笨蛋”的言论。这类视频的制作需要大量的奥巴马视频或照片数据,这些数据被输入到神经网络的软件系统中,系统会在仿造的形象与奥巴马的真实形象之间建立统计关联。如果你想让仿造的奥巴马说出他从未说过的话,软件需要学习特定单词与奥巴马嘴型之间的关联。同样的,如果需要进行换脸操作,软件还需学习脸部与身体之间的关联。

深度伪造技术的基础是生成式对抗网络(Generative Adversarial Networks,简称GANS)。这种AI技术的核心思想是通过两个神经网络的相互对抗来进行学习和改进。其中一个神经网络称为生成器,用于生成与真实数据相似的虚假数据;另一个神经网络称为判别器,用于区分真实数据和虚假数据。

以生成虚假视频或照片为例,生成器就像一个造假者,负责生成假的图像;判别器则像一个侦探,判断图像的真实性。造假者生成一张图像交给侦探,侦探会指出图像中的不真实之处,并反馈给造假者。经过不断的反馈和调整,生成器最终能够生成真假难辨的图像。

训练这个模型需要大量高质量的视频和照片数据,这就是为什么Deepfake的虚假内容多集中在政客和演员身上。因为网络上存在大量他们的影像数据,数据越丰富,生成效果就越逼真。

随着技术的进步,现在的伪造视频或图片已经很难通过肉眼识别真假。Deepfake在娱乐和电影行业得到了广泛应用,比如在《流浪地球2》中,吴京和刘德华角色的年轻形象就是通过这种技术实现的。你甚至可以看到从未存在过的电影片段,比如汤姆·克鲁斯扮演的钢铁侠。

然而,这项技术也带来了巨大的威胁,因为你很难确定你在网上看到的内容是否是真实的。所谓“眼见未必为实”!前面提到的泽连斯基视频就是一个典型案例;据称,超过90%的Deepfake技术被应用于色情片,大量女性因此成为受害者。这项技术被用于诈骗,更是令人不安。

那么,有没有办法检测到伪造的视频或图片呢?

如果是质量非常高的Deepfake视频或图片,基本靠肉眼是难以分辨的,需要结合其他信息来综合判断。尽管在某些伪造视频中,如果放慢帧数,可以看到一些异常的镜头衔接,但随着技术的提升,这些异常将会越来越少,甚至消失。

最终,公众在获取信息时仍需确认信息来源的可信度,同时互联网平台应设立监管和监控机制,防止虚假信息的传播。

未来你遇到Deepfake的机会只会越来越多。因此,朋友们,当你们愉快地将自己的照片上传到公共网络时,是不是应该再三斟酌呢?

相关新闻

1分钟科普什么是deepfake视频 换脸技术引恐慌

近期,韩国面临一项新兴技术滥用的问题——深度伪造技术(Deepfake)被用于制作并传播非法淫秽影像,引起了社会广泛恐慌

2024-08-30 10:17:261分钟科普什么是deepfake视频Deepfake到底有多可怕?

Deepfake技术的可怕之处主要体现在其对个人隐私、社会信任以及法律伦理的挑战上。

2024-08-29 16:10:23Deepfake韩国Deepfake事件频发:女性受害预警

近期,网络上流传着一名自称为“住在韩国的少女”的求助信息,她指出韩国存在广泛且严重的“deep fake”现象,即有人利用熟人的社交媒体照片和头像制作虚假图像,以此来戏弄和欺骗女性

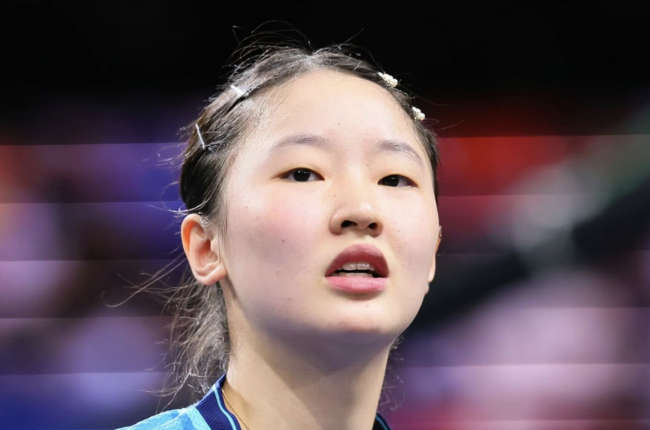

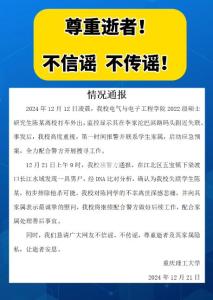

2024-08-30 11:28:41韩国deepfake中科院女工程师开源AI模型对抗deepfake

2024-09-04 11:36:24中科院女工程师开源AI模型对抗deepfake女工程师张欣怡开源AI模型对抗deepfake

2024-09-04 13:15:13女工程师开源AI模型对抗deepfake韩国新型性暴力产品层出不穷 Deepfake驱动的性犯罪浪潮被曝光

韩国正面临由深度伪造技术(Deepfake)驱动的性犯罪浪潮,这些犯罪行为在Telegram群组中悄然蔓延

2024-08-29 18:31:49韩国新型性暴力产品层出不穷