欧盟达成人工智能法协议 预计将产生全球性影响(2)

协议达成前夕唯一重要的变化就是关于生成式人工智能模型,“这些模型的设计和开发必须符合欧盟法律和基本权利,包括表达自由。”

《人工智能法》还禁止“有目的的”操纵。“有目的的”这个词有争议,因为可能难以证明故意性,但仍被保留下来。

另外,在执法、边境管理、工作场所和教育领域,法案要求禁止使用AI驱动的情绪识别软件。

欧盟立法者对预测性警务(predictive policing)的禁令从刑事犯罪扩展到了行政犯罪,其依据是荷兰儿童福利丑闻,该丑闻中成千上万的家庭因有缺陷的算法而被误判为欺诈。

高风险分类变化

许多人工智能工具可能被认为是高风险的,例如用于关键基础设施、执法或教育的工具。它们比“不可接受”低一级,因此不会被完全禁止,但需要在操作中保持高度透明。高风险人工智能的使用者可能需要完成严格的风险评估,记录他们的活动,并向当局提供数据以供审查。这可能会增加公司的合规成本。

最初的提案将某些关键领域和用例的人工智能解决方案自动归类为高风险,这意味着供应商必须遵守更严格的制度,包括对风险管理、透明度和数据治理的要求。欧洲议会引入了一个额外的层次,使这些类别的人工智能模型只有在对健康、安全或基本权利构成重大风险的情况下才会被视为高风险。

重大风险被定义为“由于其严重性、强度、发生的概率和影响的持续时间而具有重大意义的风险,并且能够影响一个人、多个人或一个特定群体”。

根据绿党的要求,用于管理能源网或水系统等关键基础设施的人工智能,如果带来严重的环境风险,也将被归类为高风险。

此外,中左翼立法者还争取到了一个规定:根据《数字服务法》(DSA)的定义,超大型在线平台的推荐系统将被视为高风险。

欧洲议会议员为高风险人工智能模型的提供者处理敏感数据(如性取向或宗教信仰)以检测负面偏见的过程,纳入了额外的保障措施。此外,评估必须发生在受控环境中。敏感数据不能被传输给其他方,并且必须在偏见评估后被删除。提供者还必须记录数据处理发生的原因。

《国家法律评论》4月26日报道称:“《人工智能法》将产生全球性的影响,因为它将适用于在欧盟提供或使用人工智能系统的组织;以及位于第三国(包括英国和美国)的人工智能系统的提供者或使用者,如果这些人工智能系统产生的输出在欧盟使用。”

相关新闻

欧盟9国呼吁加强人工智能领域合作

新华社瓦莱塔9月20日电(记者陈文仙)地中海地区9个欧盟成员国负责数字经济领域的部长20日在马耳他阿塔尔德举行部长级会议,讨论应对人工智能带来的挑战,并呼吁加强人工智能领域的合作

2023-09-21 13:52:04欧盟9国呼吁加强人工智能领域合作欧佩克与非欧佩克产油国达成减产协议

2023-06-05 07:56:30减产协议欧盟批准跨大西洋数据传输新协议

新华社布鲁塞尔7月10日电(记者付一鸣)欧盟委员会10日批准了一项欧美间数据传输新协议《欧盟-美国数据隐私框架》(简称《框架》),以更好地保护输美欧盟公民个人数据的安全

2023-07-11 12:51:01欧盟批准跨大西洋数据传输新协议欧盟峰会未就移民政策达成一致

2023-07-01 04:21:01欧盟峰会未就移民政策达成一致欧盟领导人非正式会议未就移民问题达成一致

2023-10-07 06:21:01欧盟领导人非正式会议未就移民问题达成一致债务上限协议尚未达成 美参议院下周仍将休会一周

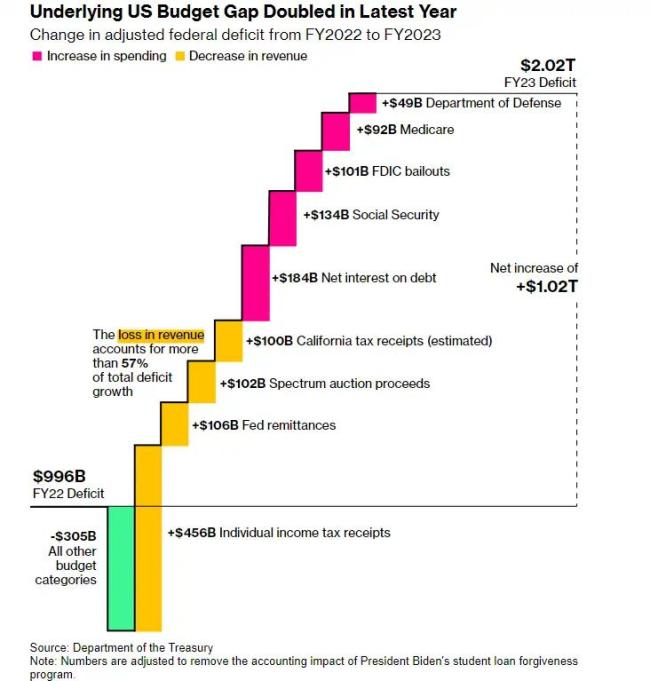

当地时间5月18日,美国参议院民主党领袖查克·舒默宣布,尽管白宫和国会领导人之间没有就提高债务上限问题达成协议,但参议院仍将按计划在下周进行为期一周的休会。

2023-05-19 09:02:03债务上限