“恐怖直播”警示网络监管新挑战

新西兰恐怖袭击事件还在持续发酵中。由于枪手在社交媒体上进行了“恐怖直播”,新西兰总理阿德恩19日在议会表示,应关注社交媒体在此事中的角色。这凸显出近年来蓬勃兴起的网络直播给网络监管带来的新挑战。

新型媒体每次兴起,在给社会带来好处的同时,也可能被用于传播不良内容。比如在2011年的伦敦骚乱中,社交媒体被骚乱分子用于互通信息和策划攻击;近两年网络直播快速发展,暴力、色情、低俗等内容也成为了一些直播平台上的毒瘤。

韩国2013年的电影《恐怖直播》,还只是虚构了一个恐怖分子利用传统广电媒体的故事,而新西兰15日枪击事件在社交媒体“脸书”上的“恐怖直播”,在17分钟后才被制止,说明了快速变化的媒体生态下网络监管所面临的严峻挑战。

挑战之一在技术方面。社交媒体上的用户生成内容是海量的,此次“恐怖直播”相关视频被大量复制和转发。“脸书”表示,在袭击事件后24小时内,已经删除了150万个相关视频。一些被上传到视频网站的视频已经过修改,现有系统无法自动识别出视频是否包含恐怖内容。

海量视频只能依赖机器识别,而与识别文字与图片相比,让机器判断视频内容确实要困难得多。目前一些人工智能技术已经能够“看懂”某些视频内容,所缺的还是相关的训练和实际应用。

新西兰广告主协会等机构在18日发表的一份声明中质问:“如果网站所有者将广告推送给目标受众的时间可以微秒计算,为什么同样的技术不能用于阻止此类内容直播?”

这个问题指向了另外一大挑战,那就是有关各方的意愿。社交媒体网站作为企业,往往优先将新技术应用到广告这种产生收益的领域,而非审核内容等具有公益性的方面。

推荐阅读

美国夏威夷两座火山持续喷发 当地派出国民警卫队

海外网2022-12-07 10:57:27

美国批准向波兰出售总价值达37.5亿美元的武器装备

央视新闻客户端2022-12-07 10:49:40

西班牙点球大战遭淘汰 葡萄牙大胜瑞士晋级

新华网2022-12-07 10:05:29

曝赖清德对接任民进党主席犹豫不决 民进党各派系明争暗斗

海峡导报2022-12-07 09:27:44

朝鲜连续实弹射击反制韩美军演 韩军多次向朝鲜发出警告

环球网2022-12-07 09:33:53

胡锡进:我不相信这个国家里会有绝对反对放开封控的人

胡锡进2022-12-07 09:44:10

2023年元旦放假安排来了!元旦放假安排:3天假不调休

2022-12-07 11:07:11

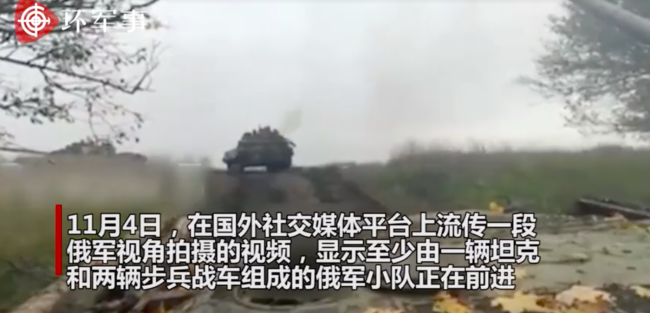

坐满士兵的俄军BMP-2步兵战车触雷爆炸画面曝光:大量步兵撤退

环球网2022-12-07 11:09:44

俄媒:泽连斯基正拍卖乌克兰,美国只能借机收割欧洲资本

腾讯网2022-12-07 09:07:33

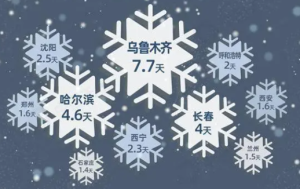

大雪节气谁是真正下雪王 乌鲁木齐出人意料夺冠军

2022-12-07 10:27:16

男孩时隔4个月见父母礼貌喊叔叔 引发无数父母感慨

2022-12-07 10:21:11

金毛眼球被抠流落街头被救后离世 多狠毒的心下得去手呢

2022-12-07 10:13:10

韩国财阀与前总统女儿离婚 并承认自己有婚外子女

海外网2022-12-07 09:41:49

恩师希望梅西拿到世界杯后就退役:那是最好的结局

2022-12-07 10:41:41

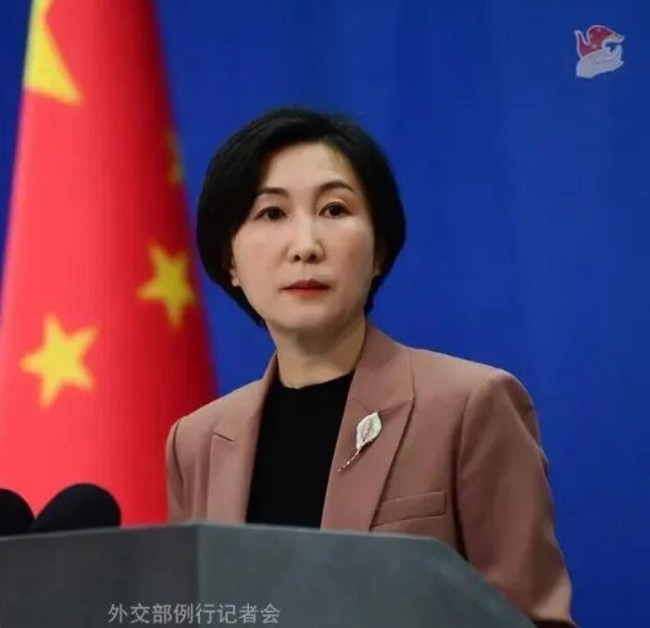

布林肯发涉中国防疫言论 中方回应 这几年中国疫情防控方针政策是正确、科学、有效的

环球网2022-12-07 09:36:02

乌媒:泽连斯基发视频,透露自己在顿巴斯地区 ,庆祝乌克兰“建军节”

新京报2022-12-07 09:11:19

俄军装备“上新” 新一批苏-35S战机即将抵达,开足马力生产了

央视网2022-12-07 09:18:01

辞职后连夜逃亡的贪官出镜痛哭:东窗事发,一逃了之

2022-12-07 10:17:09

男子醉驾致2死1伤却浑然不知 不知道毁了几个家庭

2022-12-07 10:50:38

台积电赴美设厂引多重疑虑 岛内普遍担心台湾将被掏空

环球时报2022-12-07 10:30:14

新冠康复女孩:终于敢承认自己阳过 不好意思曾很压抑自己

2022-12-07 11:02:35

权威专家:别怕发热 像感冒一样对待!要转变防控重点

2022-12-07 11:11:44

外交部回应朔尔茨文章涉华表态 孤立中国、限制对华合作不符合任何一方利益

新京报2022-12-07 10:57:57

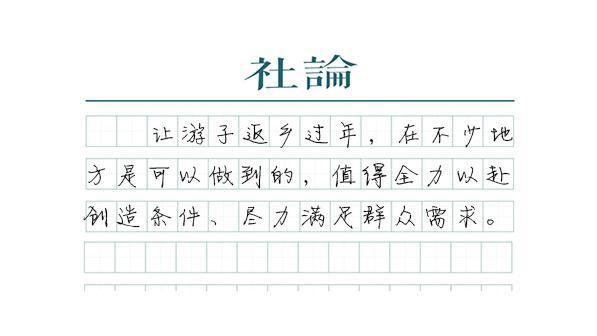

媒体:久违了!欢迎回家过年 一句话抚慰漂泊游子心

2022-12-07 10:02:01

康复患者:我终于敢承认自己阳过

2022-12-07 10:35:40

曝李四川接受邀请将出任台北副市长 在蒋万安“三顾茅庐”之后已决定接受蒋邀请

中国台湾网2022-12-07 09:29:51

乌克兰为何要深入俄腹地空袭?俄罗斯本土连续两天遭袭!

上观新闻2022-12-07 10:34:14

以色列海上新盾“C-穹顶”问世

海洋防务前沿2022-12-07 09:21:45

多地零售药店布洛芬和泰诺林售罄,多方回应!

2022-12-07 10:40:14

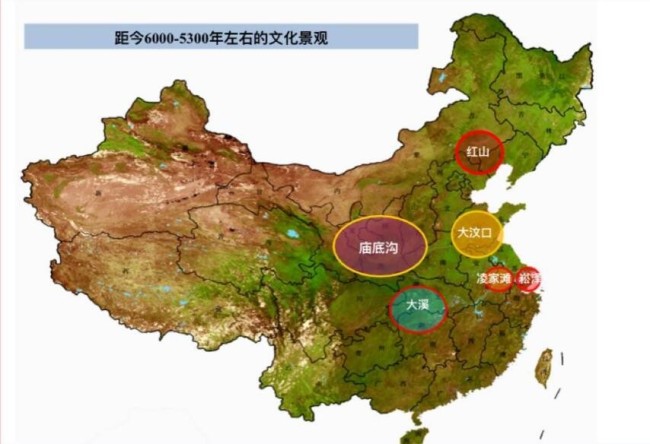

美杂志:中国发现5000年前房屋遗址 人工壕沟等设施展现军事实力

环球网2022-12-07 11:03:30

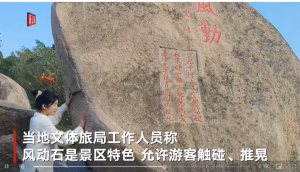

景区回应多人推山顶“风动石”:景区特色 允许推

新京报2022-12-07 10:10:15

落马区委书记贪腐上亿元,被判19年!刚当区长就安排2人伺候

2022-12-07 10:10:05

俄总统新闻秘书:普京经常亲自驾车 他常开一辆小电动汽车

中新网2022-12-07 10:40:51

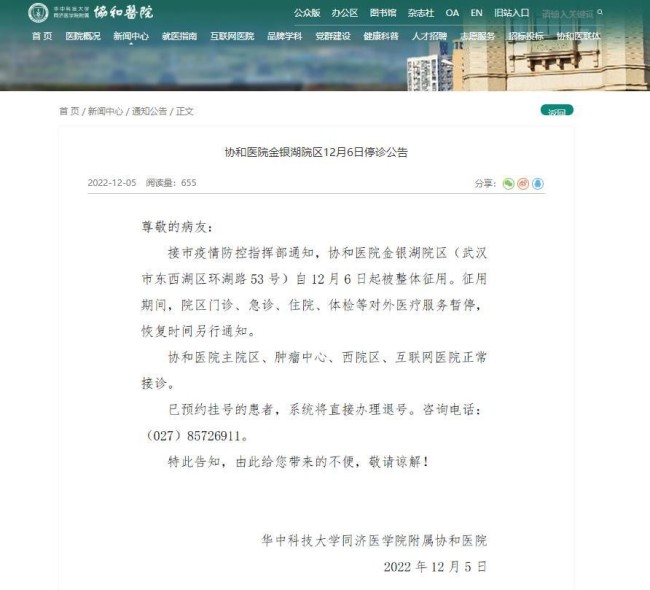

武汉协和医院金银湖院区被整体征用 已在该院区预约挂号的患者,系统将直接办理退号

央广网2022-12-07 09:37:28

男子买饼需求全被老板说服?网友:没见过这样的pua!

2022-12-07 10:17:45